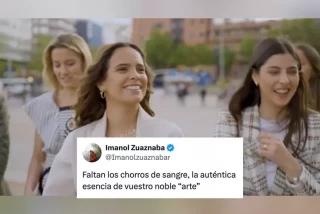

"Hola Julia. ¿Con qué foto te sientes más identificada?". Escríbeme. Firmado: Anónimo." "Ya había oído hablar de los 'deepnudes', pero no era realmente consciente del problema hasta que me pasó a mí. Para mí era algo anecdótico que ocurría en la vida de otras personas pero no en la mía." El 98% de las imagenes sexuales ultrafalsas representan a mujeres. Y el 7% de los jóvenes belgas ya ha creado un desnudo generado por IA. Una reciente directiva de la UE ha adoptado normas más estrictas contra la ciberviolencia.

|

etiquetas: testimonio , modelo , víctima , desnudos , generados , ia , deepnudes

Así que no me extrañaría que eso se acabase "normalizando" en mucha gente, como el que se mete en noporHub, o el que se imagina a su compañera de clase o mira una foto suya del facebook/instagram, pero pasando primero por la app para combinarlo con un video. Aunque se hagan "leyes" al respecto, al ser algo que elabora uno mismo a nivel local (aunque haya servidores que lo hagan dependiendo de la app, pero también se puede hacer en local), pues ancha es Castilla.

Hasta hace cuatro dias, la izquierda no veia nada malo en el desnudo.

Otra cosa es ya el porno, que me daria igual, pero si comprenderia que a otros no.

El unico problema que veo es que me perjudique en esta sociedad timorata, en el trabajo o similares.

Quitando el tema sexual y lo que supone o no en esta sociedad, sí veo al menos problema en cuanto a protección de datos y que el dispositivo personal de quien los produzca puede ser o robado o hackeado y que eso acabe apareciendo hasta en la sopa. Hablamos de nopor, claro, que tampoco es exactamente lo mismo una foto con un desnudo que un video completo de un gangbang hardcore o de una sesión de bdsm.

Aparte del tema, claro, de lo que puede pensar tu prima o tu compañera de clase/trabajo de que la veas de esa forma.

Y a ti personalmente te puede parecer que no pasa nada, a mí también me parece que un video sexual o un desnudo no es para tanto, pero ambos sabemos que no todo el mundo piensa como nosotros y que se puede hacer mucho daño a alguien con algo así.

Puedo imaginarme que con tantas peticiones de publicidad en, qué se yo, Twitter u otras, esos procedimientos de aceptación estén automatizados y además sean lo suficientemente numerosos como para que pueda ser algo complicado hacer moderación manual, pero sigo sin entender cómo puede ser tan "imposible" su filtrado, aunque sea usando IA. Es tan sencillo como que si sale un famoso o lo que sea, se compruebe si el mismo ha dado su consentimiento con la documentación correspondiente, eso se puede automatizar. Y controlar los anuncios más potencialmente timescos, como los que hablan de inversiones.

Pero ojo, también es cierto que yo me refería sobre todo al hecho de que eso se "leakeara" sin intención de chantajear, simplemente por "disfrute del personal", pero derivando todo ello en consecuencias bastante indeseadas, pérdida total de la intimidad y de la propia imagen, etc.

En cambio, si se hace por acoso, aunque obviamente sigue jodiendo muchísimo (no le quito importancia ni muchísimo menos, al revés) también se puede "devolver". Antes no se podía porque se usaban imágenes reales que tenía tu pareja o lo que fuera, pero una vez que es con deepfake que es fácil de crear, se puede hacer ojo por ojo exponencial.

cc #6

cc #11 Para que no decaiga la fiesta.

Las flataformas no hacen una p. m. con la mayoría de publicidad que sale (que suele ser una *utísima *ierda, además)

Lo comento por la app que le salió en la publicidad o en el correo que envio que cita de tiktok

Y no es algo peyorativo sobre las mujeres, simplemente es ley de oferta y demanda. Si se desnudan es porque hay muchos hombres (y alguna mujer homosexual) que pagan. La situación habla peor de los hombres (salidos pagafantas) que de las mujeres.

De hecho, de los hombres que se desnudan creo que también había mayoría de hombres pagando.

Ojala me chantajearan con un fake, les iba a caer una...Facil comparar los dos cuerpos

Hay que ser descarado...

Efectivamente hay más víctimas mujeres porque como mismo pasa en OnlyFans y similares (donde son las mujeres los usuarios más populares y las que ganan auténticas fortunas) el deseo y la estimulación (principalmente visual) es distinto entre hombres y mujeres.

Me lo creo, no hay que ser muy lince.

Pero tb existen otro tipo de deepfakes para estafar. Conoci un caso de hombre alrededor de 60 divorciado. Acudiendo a la policia acojonado, ligo online por internet con una simpatica asiatica a la que dio acceso a su facebook. Y esta le mando fotos donde aparecia el manoseando a niños (eran generadas por ia), con amenazas de o le entregabs dinero o la difundian a todos sus contactos.

Lo tomo como broma.

Pero solo si te esfuerzas.

Deberas escoger mejor las metaforas.

Si veis foto mía con el rabo en la mano, fue la IA.